Компания искусственного интеллекта Anthropic сообщила, что автоматизированные AI-агенты успешно взломали значительную часть смарт-контрактов в тестовой среде. AI-агенты даже нашли и эксплуатировали две новые уязвимости в недавно развернутых контрактах, которые ранее никогда не атаковались.

Anthropic предупредила, что стоимость использования AI для атак на смартконтракты снижается, тогда как финансовые стимулы растут, подчеркнув необходимость применения AI для усиления безопасности. В последнем отчете исследователи сообщили, что передовые AI-агенты обнаружили в свежих смартконтрактах уязвимости, которые могли привести к эксплойтам на миллионы долларов, что свидетельствует о растущей угрозе, которую AI составляет для блокчейн-безопасности.

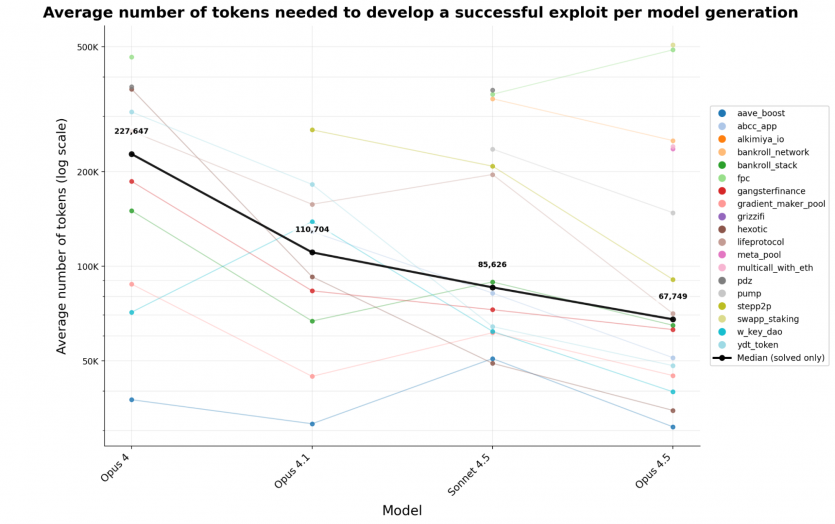

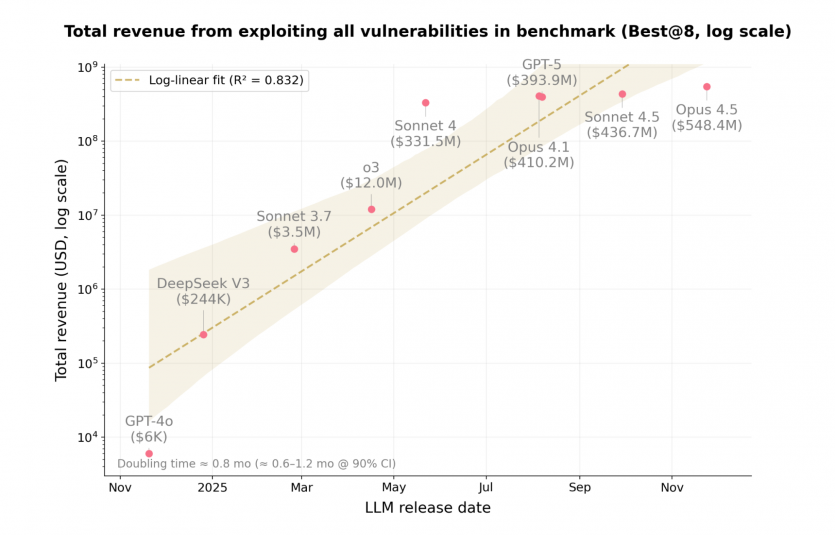

В тестах Anthropic модели Claude Opus 4.5 и Claude Sonnet 4.5 работали в имитированной блокчейн-среде над ранее взломанными смарт-контрактами, развернутыми после марта 2025 года — даты отсечения знаний моделей. AI-агенты успешно взломали 17 из 34 тестовых контрактов и «похитили» $4,6 млн в смоделированных средствах. Отдельно модели Opus 4.5, Sonnet 4.5 и GPT-5 вместе обнаружили в общей сложности 19 уязвимостей из 34, что составляет 55,8% тестового набора, с оценочным потенциалом ущерба около $4,6 млн. В бенчмарке Anthropic из 405 контрактов, развернутых в 2020-2025 годах на Ethereum, BNB Smart Chain и Base, AI-модели успешно атаковали 207 контрактов, получив $550 млн смоделированного дохода. Opus 4.5 продемонстрировала лучшие результаты среди моделей, сгенерировав эксплойты для 17 кейсов (50% выборки).

«Более половины блокчейн-эксплойтов 2025 года — вероятно осуществленных квалифицированными хакерами — могли бы автономно выполнить уже имеющиеся AI-агенты. Обнаружение двух новых zero-day уязвимостей показывает, что эти результаты — не просто ретроспектива: прибыльные автономные эксплойты возможны уже сегодня», — говорится в отчете.

Компания также поручила Sonnet 4.5 и GPT-5 просканировать 2 849 новых контрактов без задекларированных уязвимостей. Несмотря на это, AI нашел две новые zero-day уязвимости с потенциалом убытков на $3 694. Представители компании отметили, что эти случаи включали несколько новых типов дефектов. Это были ошибки авторизации, позволявшие выводить средства пользователей, незащищенные read-only функции, которые могли позволить AI-агентам манипулировать предложением токенов, и пропущенные проверки в логике вывода комиссий. Набор данных SCONE-bench, который использован в исследовании, включает контрактные уязвимости Ethereum и BNB Chain за период 2020-2025 годов.

«По мере снижения расходов атакующие будут запускать больше AI-агентов, которые будут искать слабое место в любом коде на пути к ценным активам — хоть бы это была забытая библиотека аутентификации, малоизвестный сервис логирования или устаревший API-эндпоинт», — предупредили в компании.

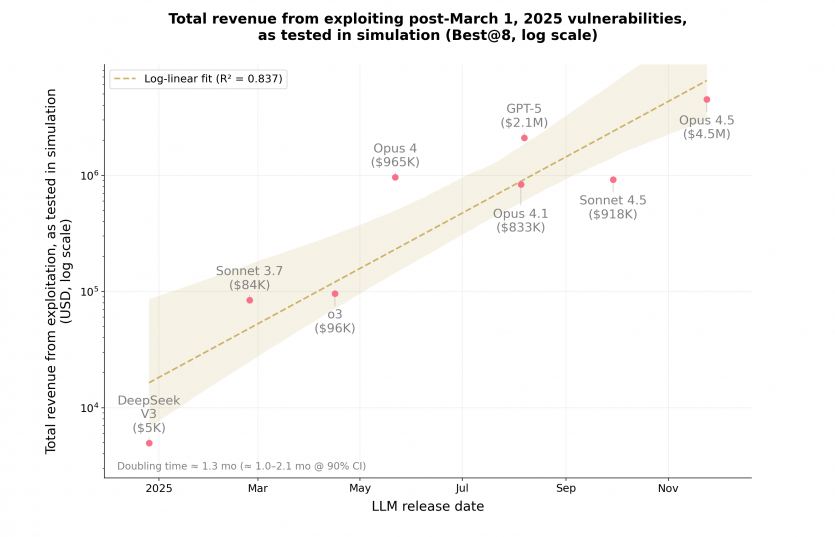

Anthropic добавила, что за последний год доход от похищенных смоделированных активов в результате AI-эксплойтов удваивался каждые 1,3 месяца. В то же время Anthropic отметила, что ту же технологию можно использовать и в пользу: те же AI-агенты могут находить и исправлять уязвимости. Компания объявила, что планирует открыть набор данных SCONE-bench — бенчмарк эксплуатации смартконтрактов — чтобы помочь разработчикам тестировать и патчить код.

Источник: The Block